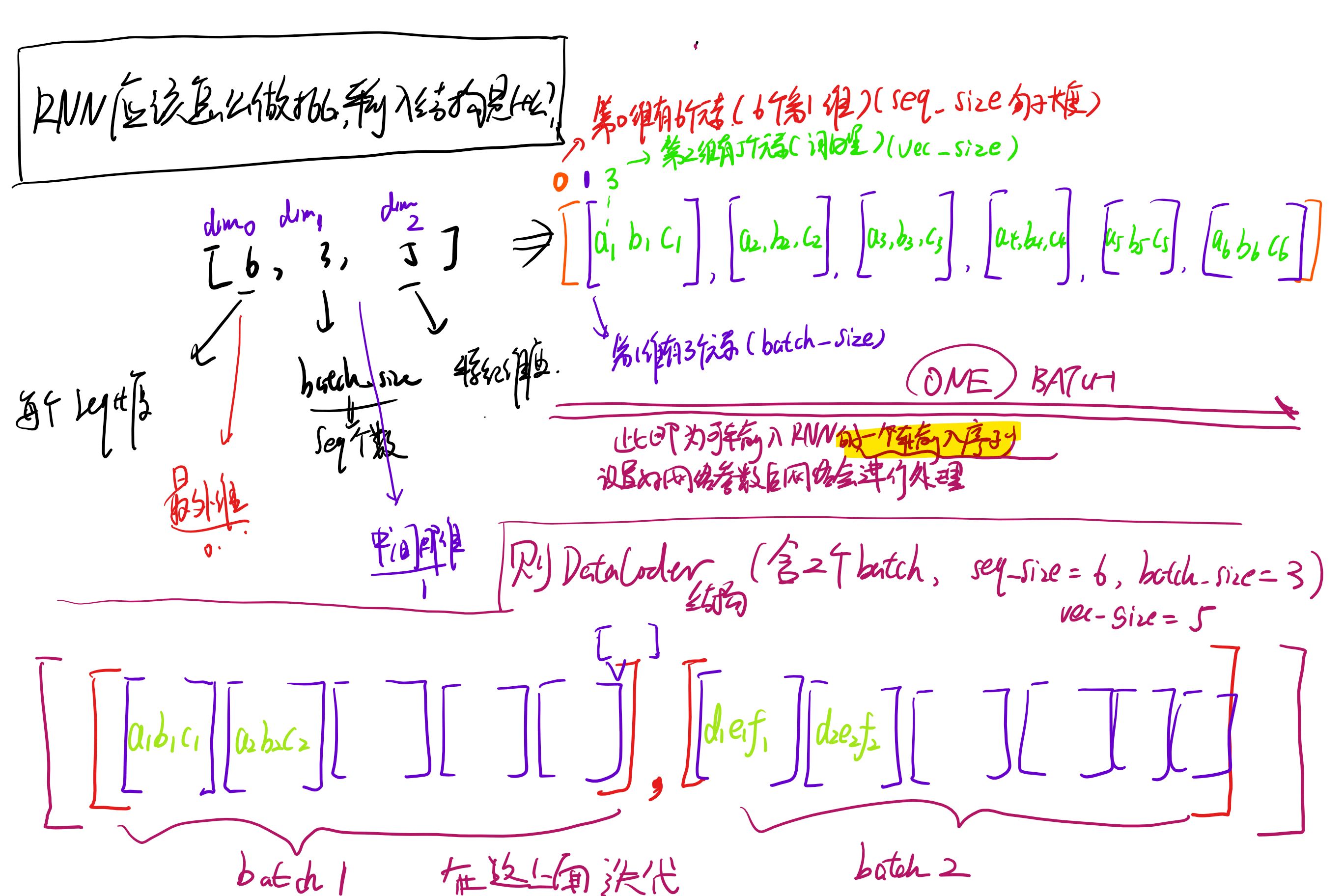

输入RNN的是时间序列,与CNN是反过来的。CNN的输入是输入(batch_size,$C_{in},H_{in},W_{in}$),而RNN的输入是(seq_len, batch_size, input_size),batch_size位于第二维度。

在CNN中我们是要在同一时间里输入batch里每张图,而在RNN里我们是要在同一时刻输入一个batch里每个序列的同一个位置。

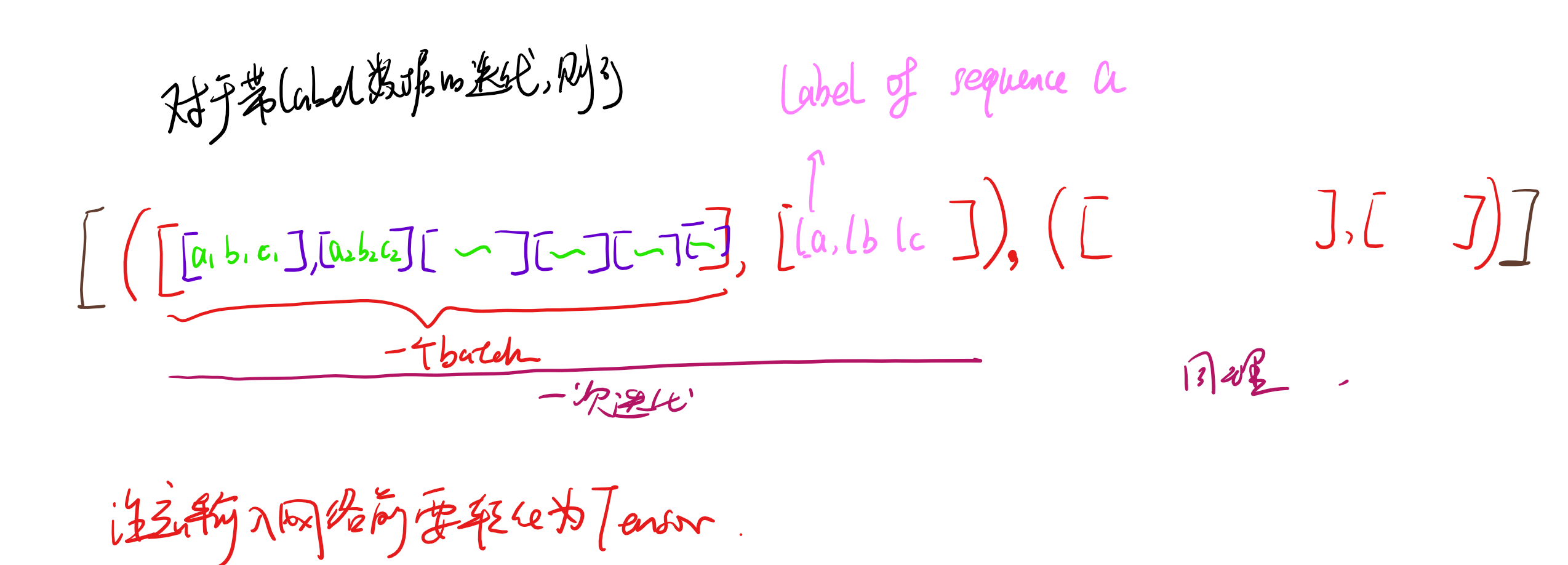

训练每个batch后,使用ERM进行BP计算,与CNN一样

以下画图理解,注意紫色是实体结构

于是对于一个可迭代的dataloader

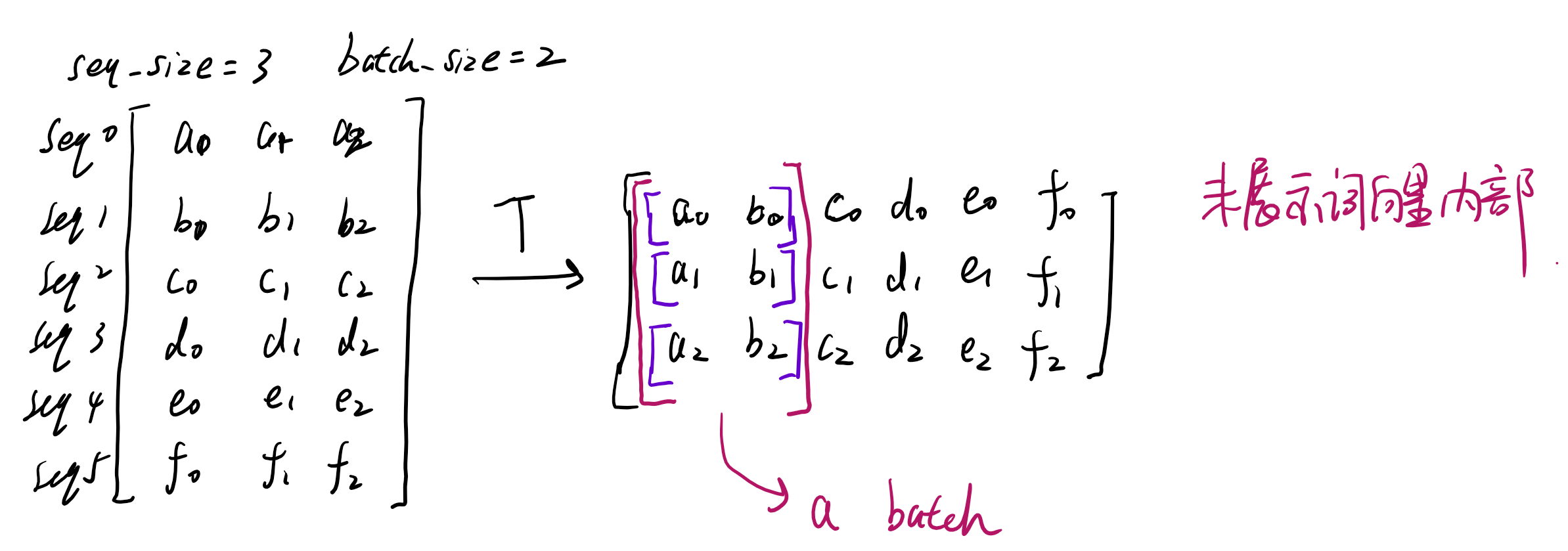

对语料矩阵进行转置后可以更快捷方便生批